Nella storia della tecnologia il 2023 sarà ricordato come l’anno nel quale l’opinione pubblica ha aperto gli occhi sulla potenza dell’intelligenza artificiale (IA). L’IA generativa applicata ai prodotti culturali non tocca semplici beni di consumo ma incide su una sfera che ha forti implicazioni identitarie e sociali. Più di un campanello di allarme è suonato per artisti e creativi di fronte a un concorrente che sembra destinato a togliere valore alla loro professionalità. Le norme a tutela della creatività, come attribuito tipicamente umano, sono, in linea di principio, quelle per la protezione del diritto d’autore, ma è tutt’altro che chiaro se e come si possano applicare agli sviluppi dell’IA.

Accanto alla curiosità, meraviglia e interesse, tra i sentimenti suscitati dal lancio al pubblico delle applicazioni di intelligenza artificiale (IA) di Open AI, Stability AI, Midjourney o DeviantAr ci sono anche inquietudine e paura. L’interesse generalizzato è stato sollevato dalle prestazioni di ChatGTP e di altri sistemi di IA in grado di “dialogare” con l’utente in modo naturale grazie a Large Language Model (LLM) e, soprattutto, di evolversi con sorprendente rapidità in modo non determinato dalla programmazione iniziale. Il parlamento europeo ha deciso di riconsiderare alcuni aspetti non secondari del Regolamento sull’Intelligenza Artificiale da emanare entro l’anno, finora dedicato esclusivamente ai sistemi di intelligenza artificiale considerati “ad alto rischio”, come i sistemi di riconoscimento antropometrico e di sorveglianza. Da una parte, forse per una fortunata coincidenza, la diffusione negli ultimi mesi di queste applicazioni di IA generativa hanno creato nella pubblica opinione e nei politici la consapevolezza che l’iniziale proposta di regolamento non affrontava altri rischi, che toccano la vita e il lavoro di milioni di persone in Europa. Dall’altra, le norme del regolamento non possono essere collegate direttamente allo stadio attuale della tecnologia perché questo potrebbe rendere problematica o inadeguata la loro applicazione futura. In questo settore la tecnologia sembra capace di improvvisi “salti” verso il futuro che le procedure legislative in generale e quelle europee in particolare sembrano del tutto inidonee ad affrontare. A livello politico si deve quindi trovare un difficile punto di equilibrio tra quanto noto oggi e gli sviluppi che si intende regolare nel medio periodo, basato su trasparenza e possibilità di monitoraggio. Sarebbe soprattutto sbagliato cercare analogie tra l’odierno intenso dibattito su ChatGPT e il clamore attorno agli NFT dopo il 2020. La bolla che aveva fatto salire il valore degli scambi di NFT a livelli imprevedibili si è sgonfiata; si va ora verso una “normalizzazione” graduale che riconduce gli NFT alla loro funzione di certificazione e garanzia (sempre nei limiti della correttezza dei dati immessi nella blockchain). In qualche modo Blockchain e NFT stanno entrando nel quadro degli strumenti a disposizione delle imprese, superato il momento dell’eccitazione acritica sul metaverso che (forse) verrà.

Mentre il valore di certi collectible NFT è diminuito vertiginosamente rispetto picco raggiunto nel 2021, le imprese hanno appreso la lezione e, ispirati dal mercato degli “skin” dei videogiochi e, preoccupati di arrivare in ritardo nei mondi virtuali, tutti i maggiori brand ampliano la registrazione dei loro marchi alle merci virtuali, sia in Europa che negli USA. Gucci ha costituito un’unità Web3, per sperimentare le opportunità offerte dagli NFT e progettare la presenza del brand nel metaverso; Tiffany ha lanciato iniziative che consentono la conversione di NFT, il cui valore è espresso in criptovaluta, in oggetti reali con valore espresso in dollari [1]. Fanno parte della “normalizzazione” anche le vertenze giudiziarie sorte nel frattempo. Yuga Labs [2] ha vinto la causa per violazione del marchio contro Ripps e Cahen, i quali - sotto la denominazione NFT Ryder Ripps Bored Ape Yacht Club ("RR/BAYC") - hanno commercializzato NFT associati alle stesse Scimmie Annoiate digitali, sostenendo che si trattasse di un "progetto di performance e arte concettuale satirica" e di "appropriation art". Nel caso Metabirkin Hermes, il giudice non ha ritenuto che gli NFT associati alle immagini elaborate della famosa borsa potessero rientrare nel concetto di fair use, senza per altro entrare nel merito del loro autonomo valore artistico. L’artista Rothschild è ricorso in appello. Anche in Italia, nel cosiddetto e-sport, ci sono state conferme dell’applicabilità agli NFT delle regole sulla protezione dei marchi. Interessante la causa della Juventus, contro la società Blockeras, che aveva riprodotto i marchi e le maglie della Juve nelle carte digitali di un gioco online, mediante NFT. Il tribunale di Roma non ha avuto dubbi ed ha inibito produzione, commercializzazione, promozione e offerta in vendita degli NFT e dei contenuti digitali associati (la maglia a strisce verticali bianco e nere con due stelle sul petto), richiedendone anche la rimozione da ogni sito internet controllato [3]. La Juve stessa aveva nel frattempo deciso di sfruttare il marchio e l’immagine, licenziando a Sorare [4] il lancio di NFT con immagini tridimensionali dei suoi giocatori. Sul piano amministrativo, la nuova Guidance sui marchi per merci virtuali pubblicata dall’Ufficio Proprietà Intellettuale UK il 3 aprile 2023, segue le linee indicate nella normativa europea dell’EUIPO nel 2022 e propone la seguente definizione di NFT “a unique unit of data (the only one existing of its type) that links to a particular piece of digital art, music, video etc. and that can be bought and sold” [5]. Come già precisato dall’Ufficio dell’Unione europea per la proprietà intellettuale (EUIPO), “Downloadable digital files authenticated by NFTs” rientrano nella Classe 9 della classificazione di Nizza [6]. A differenza degli NFT che sono argomento di discussione anche tra il grande pubblico, senza tuttavia divenire un fenomeno di massa in termini di esperienza dei consumatori, l’intelligenza artificiale ha mosso lentamente i suoi primi passi quasi inosservata, presente da tempo in molti momenti della vita quotidiana, ad esempio con le chatbox evolute che sostituiscono l’assistenza ai consumatori oppure con gli algoritmi di certi servizi, che orientano raccomandazioni o pubblicità mirate mediante IA. Di recente, Spotify ha reso pubblici alcuni parametri del suo sistema IA, basato sui dati prodotti da 515 milioni di utenti mensili del suo servizio. In campo musicale la IA generativa ha effetti ben più sorprendenti dei generatori di testo IA già usati per redigere post sui social media o per gli assistenti vocali tipo Alexa. L’attenzione è salita quando i sistemi IA hanno replicato le voci di artisti famosi e cominciato a pubblicare video sulle maggiori piattaforme con avatar e deepfake. È successo al rapper Drake [7] e alla cantante Rihanna [8] di trovare in rete duetti virtuali con canzoni che non hanno mai cantato. Celebrità varie vedono i loro deep fake fare cose che non hanno mai fatto e dire cose che non hanno mai detto.

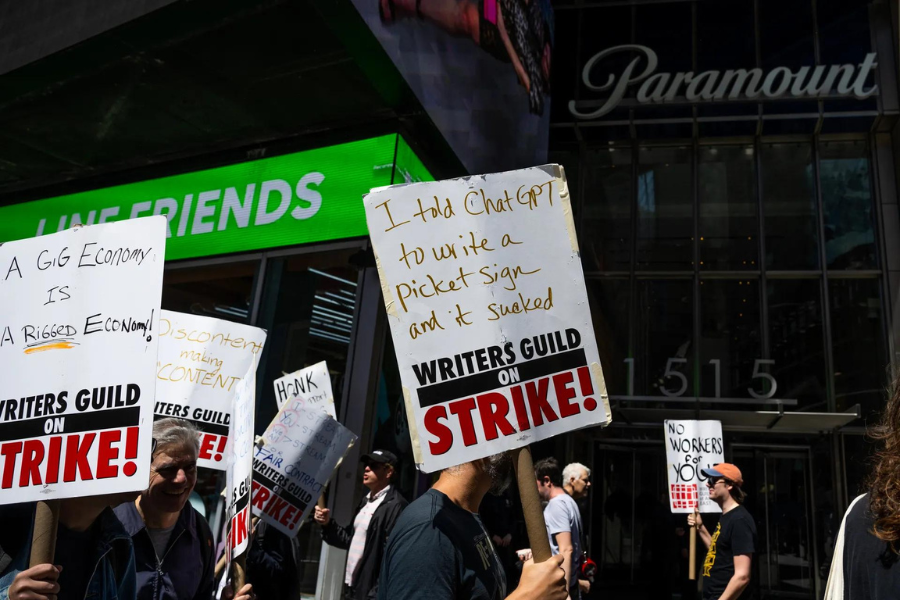

Universal Music si è schierata con forza contro l’uso di voce, immagine e stile degli artisti che hanno firmato contratti di esclusiva, ma non è chiaro se questa posizione sia assunta a tutela degli artisti stessi o piuttosto per evitare che sia ammessa la generazione di deepfake senza il pagamento di un compenso. Altrettanto ambivalente appare l’atteggiamento di servizi come Spotify o Deezer, che tributano ai musicisti rispetto e solidarietà, ma inseriscono brani AI generated in certe playlist, oppure creano servizi specifici come Deezer Zen dedicato a musiche IA per relax o white noise. La cantante Grimes ha lanciato una sfida ed ha invitato a utilizzare la sua voce per generare nuove performance, offrendo il 50% delle royalty che ne potranno derivare, una dichiarazione di intenti che non ha, per altro, un chiaro contorno legale. I casi famosi hanno fatto suonare più di un campanello di allarme per quanti, senza essere star, si trovano di fronte a un concorrente non previsto, che minaccia il loro lavoro. Applicazioni come Apple Book Digital Narration possono sostituire attori o doppiatori per la produzione di audiolibri, per le voci di videogame e negli annunci pubblicitari. L’audiovisivo è il settore nel quale l’impatto sarà prevedibilmente più intenso toccando una varietà di posizioni e di situazioni. Ad esempio, il doppiaggio della versione straniera di una serie con la voce artificiale dell’attore originale è più che un’ipotesi e lo stesso avviene per la traduzione e l’adattamento dei dialoghi. La Screen Actors Guild - Federazione americana degli artisti televisivi e radiofonici (SAG AFTRA) e la Writers Guild of America (WGA) - insieme di sindacati attivi negli USA a difesa degli sceneggiatori, hanno preso una posizione ferma ma possibilista in questa materia, affermando che termini e condizioni contrattuali che implicano il diritto a simulare voce o immagine di un artista in forma digitale per creare una nuova performance devono essere negoziate e regolate nel contratto collettivo della categoria. I produttori televisivi e cinematografici non hanno ancora assunto una posizione come categoria, ma alcuni servizi come Netflix hanno incluso nei loro contratti con gli attori clausole volte a coprire le future riutilizzazioni di voce e immagine in perpetuo e con qualsiasi tecnologia presente e futura. Piuttosto che dal copyright, potrebbe dipendere dalle leggi nazionali a difesa della personalità, quindi con limiti quanto alla cessione assoluta, una tutela della “voce”, finora non considerata separatamente dall’immagine. Gli output dell’intelligenza artificiale non danno luogo alla protezione del copyright, se manca del tutto l’elemento umano, come ha chiarito il Copyright Office USA nella Guidance [9] recentemente pubblicata dopo aver rifiutato ai richiedenti la registrazione delle opere “A Recent Entrance to Paradise” [10] e il recente “Zarya of the Dawn [11], una graphic novel della quale solo la parte letteraria di Kristina Kashtanova è stata riconosciuta come proteggibile, poiché i disegni erano AI generated.

Ha fatto il giro del mondo anche la cronaca del Sony World Photography Award, concorso fotografico internazionale con sede a Londra, che ha visto il vincitore, Boris Eldagsen, rinunciare al premio, rivelando che l’opera era stata prodotta da IA. Le norme europee e statunitensi sono allineate sulle convenzioni internazionali in materia di diritto d’autore che attribuiscono la titolarità originaria dei diritti solo alle persone fisiche, escludendo quindi i computer e i sistemi di IA generativa. Per i diritti connessi degli artisti interpreti o esecutori la protezione potrebbe presentare aspetti ancora più controversi e, in mancanza di protezione dell’opera generata da IA, rimane il dubbio circa la proteggibilità della prestazione artistica. In altri termini, l’output IA è in pubblico dominio (e quindi la prestazione è proteggibile) oppure non è qualificabile come opera dell’ingegno e questo esclude anche la protezione dei diritti connessi? Le capacità evolutive della IA dipendono dalla possibilità di elaborare di contenuti che circolano in rete, dall’accesso ai dati e, in generale, ai contenuti indispensabili perché i sistemi di IA siano addestrati e sviluppino reti neurali sempre più simili a quelle umane. La creatività è forse la meno facilmente definibile e la più intrinsecamente “umana” delle capacità. Dalla nuova consapevolezza sulla IA generativa e sulle sue implicazioni per gli utenti e consumatori, nasce la richiesta di prevedere norme specifiche sulla foundation AI, definita come “an AI system model that is trained on broad data at scale, is designed for generality of output, and can be adapted to a wide range of distinctive tasks.” [12] I giornali sperimentano da tempo le potenzialità dell’intelligenza artificiale soprattutto per articoli basati su statistiche, economia e finanza o altri campi prevalentemente fattuali; fino ad oggi, è rimasto fondamentale il controllo umano per evitare le cosiddette allucinazioni, quando il sistema IA inspiegabilmente vira verso affermazioni surreali o fabbrica notizie totalmente false [13]. Il giornalismo rappresenta un campo d’elezione per le applicazioni IA, e un editore come Axel Springer (editore dei tedeschi Bild e Die Welt) già ha ipotizzato tagli dei costi grazie a notizie redatte da IA; sono tuttavia evidenti anche i limiti perché, nonostante l’evoluzione continua, è difficile pensare che gli algoritmi della IA possano sostituirsi all’osservazione diretta della realtà o ai giornalisti che fanno giornalismo investigativo, questo potrà allo stesso tempo servirsi di strumenti IA potrà per ottenere raccogliere le informazioni in modo più efficace, completo e tempestivo.

L’intervento normativo più urgente riguarda i diritti degli utenti quanto quelli dei giornalisti, degli autori e di tutti i creativi, ed è l’introduzione di un chiaro ed adeguato obbligo di trasparenza; nella proposta di regolamento UE l’obbligo era previsto solo per le attività IA “ad alto rischio”, ma non si può ignorare l’esigenza che la pubblicazione di contenuti generati da IA sia accompagnata da chiare indicazioni sulla fonte dei dati e i sistemi per produrre l’output. Questo obbligo comporta anche la necessità di fissare regole sulla responsabilità per i contenuti generati, cosa non semplicissima per come funziona oggi la foundation AI, dove lo sviluppatore non conosce di solito per quali risultati e con quali prompt o comandi il sistema sarà utilizzato dall’utente. Il monitoraggio dovrebbe riguardare le possibili varie fasi intermedie, ad esempio quali data set servano per addestrare il sistema, quali possono essere gli interventi del provider che mette il sistema IA a disposizione del pubblico o di clienti determinati, come siano configurati i limiti tecnologici e quali siano le condizioni contrattuali per l’uso da parte di diverse categorie di utenti. Nell’attuale proposta di Regolamento UE è previsto che i sistemi foundation AI, categoria nella quale rientra l’intelligenza artificiale generativa, siano soggetti a controlli lungo tutta la filiera e le società che sviluppano questi modelli devono essere responsabili per il trattamento dei dati e per le scelte di progettazione, con obblighi quindi da rispettare anche nelle clausole contrattuali sulla responsabilità. La notizia che Meta ha messo a disposizione del pubblico i codici della sua IA rendendola di fatto opensource rende le attuali prospettive ancora più confuse visto il numero di sviluppatori che potranno avvalersene in ogni parte del mondo. Un argomento che tocca tutti i settori creativi e culturali, a ogni livello, è la capacità di machine learning (apprendimento automatico) dei sistemi, attraverso le successive iterazioni basate su web scraping (come fa Common Crawl usato da Google), l’estrazione e l’utilizzo di dati presenti in rete e in banche dati di ogni genere accessibili via Internet. Non solo celebrità, quindi, ma lavoratori che vanno dagli attori, agli speaker della pubblicità e ai compositori di musica d’ambiente, fino ai conduttori delle news, si sentono a rischio perché i sistemi IA si avviano velocemente verso una sempre maggiore sostituibilità del contributo umano. Le norme a tutela della creatività sono, in linea di principio, quelle per la protezione del diritto d’autore e della proprietà intellettuale in generale; vale la pena di cominciare a capire se e come queste norme possano essere applicabili agli sviluppi dell’intelligenza artificiale, o se esse siano destinate all’obsolescenza o all’insignificanza via via che la IA si evolve. Se si tenta una fotografia ad oggi, possiamo affermare che gli output della IA non sono protetti, e questo potrebbe essere addirittura un incentivo alla loro diffusione. Questo scenario solleva questioni non facili, relative a come in concreto regolare la circolazione gratuita dell’output, a chi si deve attribuire la responsabilità e come mitigare gli effetti sulle opere protette da copyright, visto che la produzione mediante IA ha costi e tempi incommensurabilmente inferiori.

Non è un caso che Paesi come Cina, Israele, Giappone, Corea del Sud e Singapore siano intenzionati a concedere norme di favore alle società IA, mentre i Paesi “esportatori” di cultura come USA e UK incontrano difficoltà nel portare avanti progetti di liberalizzazione per text e data mining (TDM). L’allarme di autori e artisti, con le campagne lanciate in UK e USA, non riguarda solo i livelli di occupazione di certi settori ma soprattutto i possibili effetti della IA generativa sui prodotti culturali, che non sono semplici beni di consumo ma hanno forti implicazioni identitarie e sociali. Molte incertezze sussistono sull’addestramento dei sistemi IA anche perché la direttiva sul copyright nel mercato unico digitale del 2019 sembra aprire la strada all’uso di materiali protetti nel training IA, con una mera possibilità di opt-out dei titolari, e senza chiarezza su chi e come possa effettivamente garantire che questa scelta sia rispettata. Insieme ai rischi di “estinzione” di certe professionalità, i creativi si vedono trasformati in “allenatori” involontari e spesso inconsapevoli delle “macchine che imparano”, ovvero lo strumento che li potrebbe sostituire; non aiuta la fiducia il fatto che gli sviluppatori IA tendono mantenere il segreto sui loro processi di addestramento. Non mancano iniziative nella UE, come il Manifesto in difesa dei diritti della creatività dell’essere umano dell’Associazione Mestieri del Fumetto (MeFu), che chiede che le aziende digitali, prima di trasferire ai loro sistemi IA terabyte di dati e informazioni ottengano l’autorizzazione dei titolari dei diritti. Da questa iniziativa è nata anche European Guild for Artificial Intelligence Regulation (EGAIR), una nuova associazione su scala europea, che ha fatto sua la causa del training right da inserire nell’AI Act in via di approvazione in sede europea, ed ha pubblicato un Manifesto ora in cinque lingue, che traccia le regole per un machine training eticamente sostenibile. Con tutte le incertezze sulla possibile protezione dell’output IA e sui dati utilizzati nei processi di machine learning, la IA ci mette di fronte a una questione essenziale, che si ripropone sin dalle prime leggi sulla proprietà intellettuale, riaprendo il dilemma, finora variamente risolto, tra la visione individualistica del droit d’auteur e quella commerciale del copyright. Qual è l’obiettivo? Quello sociale di garantire agli autori la remunerazione del loro lavoro a vantaggio, quindi, della libertà creativa, oppure è quello industriale di incentivo alla produzione dei contenuti? L’equilibrio tra le due concezioni non è mai apparso così fragile.

[1] Tanzeel Akhtar, Emily Nicolle, Anna Irrera, Luxury brands Gucci, Tiffany dive into nfts despite slump, Bloomberg, 22.08.2022.

[2] Yuga Labs, Inc. v. Ripps, et al., 2:22-cv-04355 (C.D. Cal. April 21, 2023).

[3] Trib. Roma, sez. XVII - Imprese, causa RG n. 32072/2022 ord., 20 luglio 2022

[4] Per una descrizione del servizio Sorare si rinvia a Io sono Cultura 2022, Incontri ravvicinati tra cultura e Blockchain.

[5] “Unità di dati unica (l'unica esistente nel suo genere) che si che si collega a una particolare opera d'arte digitale, musica, video ecc. e che può essere acquistata e venduta”.

[6] EUIPO, 2023. Elenco che descrive la natura di prodotti e servizi in termini generali, allo scopo di classificare i marchi registrati in maniera riconosciuta e accettata a livello internazionale https://euipo.europa.eu/ohimportal/it/nice-classification

[7] ll video pubblicato su Youtube è stato rimosso, mentre il brano ha raggiunto in meno di una settimana oltre un milione di accessi su Spotify.

[8] Gil Kaufman, Bad Bunny and Rihanna AI Duet Drops – and the Fake Drake/The Weeknd Creator Seems to Be Behind It, Billboard, 04.26.2023.

[9] https://www.govinfo.gov/content/pkg/FR-2023-03-16/pdf/2023-05321.pdf

[10] https://www.copyright.gov/rulings-filings/review-board/docs/a-recent-entrance-to-paradise.pdf

[11] https:// www.copyright.gov/docs/zarya-of-the-dawn.pdf

[12] "Un sistema di intelligenza artificiale allenato su un'ampia gamma di dati è progettato per output generali e può essere adattato a un'ampia gamma di compiti diversi”. Center for Research on Foundation Models (CRFM), 2021.

[13] When AI Chatbots hallucinate, New York Times, 1.05.2023.